公理だけからSchwarzの不等式を導く

数ベクトルの場合で証明した

Schwarzの不等式

\begin{align} -|\vec u|\,|\vec v|\le \vec u\cdot\vec v\le |\vec u|\,|\vec v| \end{align}は、以下のようにすると上の公理だけから証明できる。

まず、$\avec{X}\kakko{\tcol{t}}=\avec{x}-\tcol{t}\avec{y}$というベクトルを考える。正定値性より、$\tcol{t}$がどんな値であっても、$\avec{X}\kakko{\tcol{t}}\cdot\avec{X}\kakko{\tcol{t}}\ge0$である。この式を双線形性を使って展開すると

\begin{align}

\avec{x}\cdot\avec{x}-2\tcol{t}\avec{x}\cdot\avec{y}+\tcol{t}^2\avec{y}\cdot\avec{y}\ge0

\end{align}

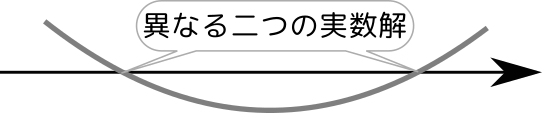

である。この式の左辺は$\tcol{t}$の2次式であり、左辺=0という式が異なる二つの実数解を持ってしまうと、グラフが のようになって負の部分が現れ、上の式は成り立たない。よって、左辺=0の判別式は0以下であり、

\begin{align}

\left(2\avec{x}\cdot\avec{y}\right)^2-4(\avec{x}\cdot\avec{x})(\avec{y}\cdot\avec{y})\le&0

\nonumber\\

\left(\avec{x}\cdot\avec{y}\right)^2\le (\avec{x}\cdot\avec{x})(\avec{y}\cdot\avec{y})

\end{align}

$\sqrt{\avec{x}\cdot\avec{x}}=|\avec{x}|$と$\sqrt{\avec{y}\cdot\avec{y}}=|\avec{y}|$は正で、$\avec{x}\cdot\avec{y}$は正である可能性も負である可能性もあるので、

\begin{align}

- |\avec{x}||\avec{y}|\le \avec{x}\cdot\avec{y}\le |\avec{x}||\avec{y}|

\end{align}

が言える。Schwarzの不等式は、いろんな場面で活躍するが、「公理だけから証明できる」ことがその汎用性を高めている。たとえば「関数の内積」に関しても

\begin{align}

\left(

\int_a^b f\kakko{x}g\kakko{x}\coldx \right) ^2 \le

\int_a^b \left(f\kakko{x}\right)^2\coldx

\int_a^b \left(g\kakko{x}\right)^2\coldx

\end{align}

のような式が示せる。量子力学では「波動関数」と呼ばれる関数をベクトルと考えるとことで、Schwarzの不等式が不確定性関係の証明に用いられる。

のようになって負の部分が現れ、上の式は成り立たない。よって、左辺=0の判別式は0以下であり、

\begin{align}

\left(2\avec{x}\cdot\avec{y}\right)^2-4(\avec{x}\cdot\avec{x})(\avec{y}\cdot\avec{y})\le&0

\nonumber\\

\left(\avec{x}\cdot\avec{y}\right)^2\le (\avec{x}\cdot\avec{x})(\avec{y}\cdot\avec{y})

\end{align}

$\sqrt{\avec{x}\cdot\avec{x}}=|\avec{x}|$と$\sqrt{\avec{y}\cdot\avec{y}}=|\avec{y}|$は正で、$\avec{x}\cdot\avec{y}$は正である可能性も負である可能性もあるので、

\begin{align}

- |\avec{x}||\avec{y}|\le \avec{x}\cdot\avec{y}\le |\avec{x}||\avec{y}|

\end{align}

が言える。Schwarzの不等式は、いろんな場面で活躍するが、「公理だけから証明できる」ことがその汎用性を高めている。たとえば「関数の内積」に関しても

\begin{align}

\left(

\int_a^b f\kakko{x}g\kakko{x}\coldx \right) ^2 \le

\int_a^b \left(f\kakko{x}\right)^2\coldx

\int_a^b \left(g\kakko{x}\right)^2\coldx

\end{align}

のような式が示せる。量子力学では「波動関数」と呼ばれる関数をベクトルと考えるとことで、Schwarzの不等式が不確定性関係の証明に用いられる。